A/B-тестирование часто воспринимается как защита от ошибок и субъективных решений. Кажется, что данные не врут, а значит, если цифры выросли, решение верное. Именно здесь и начинается главная ловушка. Данные сами по себе ничего не говорят, если человек, который на них смотрит, уже принял решение заранее.

На практике A/B-тесты нередко становятся инструментом самообмана. Команды запускают эксперименты, получают «статистически значимые» результаты и уверенно делают выводы, которые лишь подтверждают их ожидания. При этом реальные причины поведения пользователей так и остаются нераскрытыми.

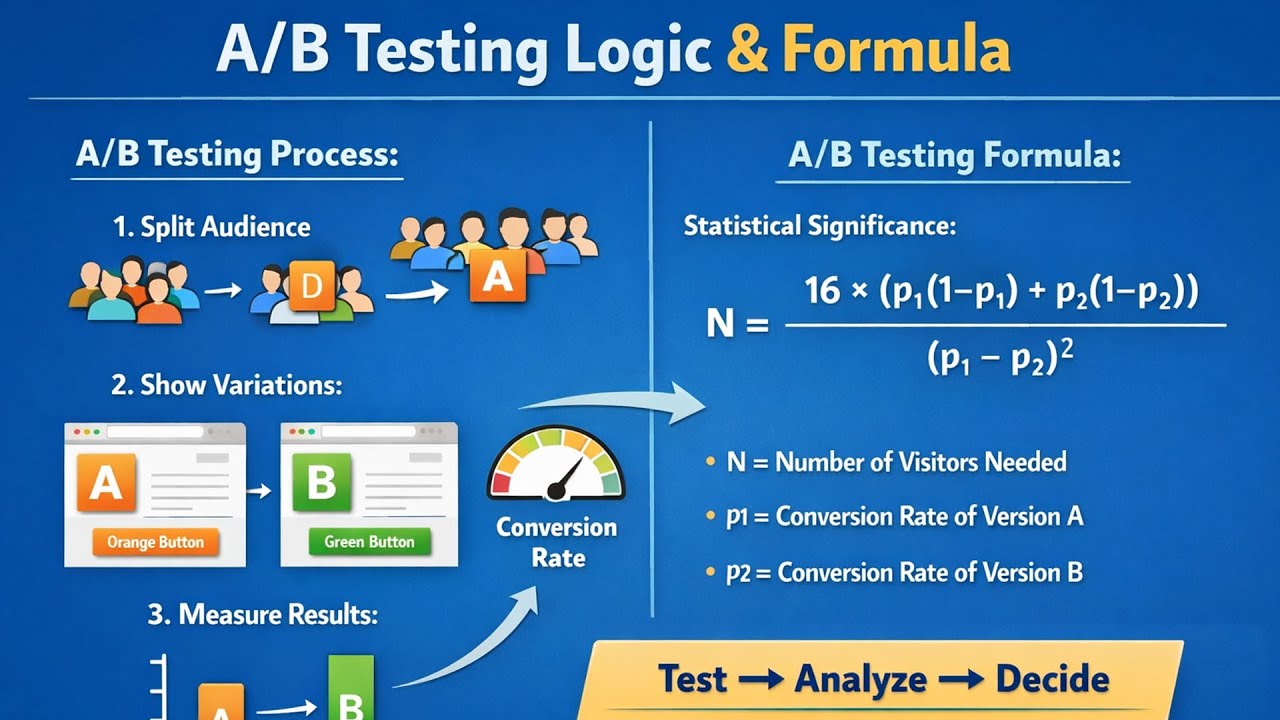

Логика A/B-тестирования нужна не для того, чтобы найти красивую цифру в отчете. Она нужна, чтобы не обманывать себя данными, не подменять мышление статистикой и не превращать эксперимент в ритуал. В этой статье мы разберем, как выстроить A/B-тестирование так, чтобы данные действительно помогали принимать решения, а не создавали иллюзию научного подхода.

Мышление, которое делает продакт-менеджмент токсичным

Когда A/B-тесты не дают ожидаемого эффекта, первой реакцией часто становится поиск виноватого. Product Manager оказывается в центре внимания, потому что именно он формулирует гипотезы и отвечает за эксперименты. Его называют «плохим», если тесты не приводят к росту метрик.

Однако в большинстве случаев проблема не в конкретном человеке, а в мышлении всей системы. PM работает в среде, где от тестов ожидают подтверждения идей, а не проверки гипотез. В такой культуре данные используются как аргумент в споре, а не как инструмент исследования.

Даже сильный PM в такой системе начинает подстраиваться. Он формулирует гипотезы так, чтобы их было легче подтвердить, выбирает удобные метрики и завершает тесты в подходящий момент. В результате создается иллюзия эффективности, но качество решений не растет.

Плохой PM - это всегда вопрос к системе, а не к человеку

Контур управления через A/B-тестирование должен начинаться с бизнес-вопроса и заканчиваться решением. В идеале команда сначала формулирует, что именно она не понимает, затем проверяет это через эксперимент и на основе данных меняет продукт или стратегию.

На практике этот контур часто разорван. Эксперименты запускаются, но не привязаны к конкретным решениям. Данные собираются, но не имеют веса в обсуждениях. Решения принимаются интуитивно, а тесты используются постфактум для оправдания выбора.

Product Manager в такой системе формально отвечает за тестирование, но не управляет его последствиями. Он не может опереться на данные, потому что в компании нет договоренности, что данные имеют приоритет над мнением. Это и создает ощущение «плохого PM», хотя проблема системная.

Ошибки и провал продукта

A/B-тестирование невозможно без ошибок. Любая гипотеза - это предположение о поведении людей, а люди ведут себя сложнее любых моделей. Ошибки в таких предположениях неизбежны и сами по себе не являются проблемой.

Допустимы ошибки в формулировке гипотез. Команда может ожидать, что изменение повлияет на метрику, а эффект окажется нулевым. Это нормальный результат, если он зафиксирован и используется для обучения.

Допустимы ошибки в выборе сегментов и вторичных метрик. Иногда эффект проявляется не там, где ожидали. Если команда анализирует это и корректирует подход, тестирование остается полезным. Ошибка становится частью процесса обучения.

Ошибки без иллюзий: что реально допустимо

Ошибка превращается в некомпетентность тогда, когда команда перестает задавать себе вопросы. Если гипотезы не уточняются, выводы не пересматриваются, а эксперименты повторяются по шаблону, данные начинают вводить в заблуждение.

Еще один признак некомпетентности - выборочная интерпретация результатов. Когда команда видит только то, что подтверждает ее ожидания, и игнорирует неудобные данные, A/B-тесты становятся инструментом самообмана.

Некомпетентность проявляется и в отсутствии связи между экспериментами и решениями. Если после теста продукт не меняется или меняется независимо от результата, значит данные используются формально.

Как это работает в настоящих условиях рынка

В discovery A/B-тесты часто подменяют собой исследование проблемы. Команда сразу начинает тестировать решения, не разобравшись, почему пользователи ведут себя определенным образом. Гипотезы формулируются поверхностно.

В такой ситуации любой результат легко интерпретировать в свою пользу. Рост метрики объясняется «успешным решением», падение - «шумом» или «неудачным периодом». Данные перестают быть источником знания.

Правильная логика предполагает, что A/B-тест проверяет конкретное предположение о поведении, возникшее из исследований и анализа. Тогда любой результат дает новое понимание, а не повод для спора.

В delivery самообман проявляется через давление сроков. Команда заранее знает, какое решение нужно принять, и тест используется как формальность. Эксперимент либо завершают раньше времени, либо игнорируют неудобные результаты.

Иногда тест продолжают до тех пор, пока цифры не «станут красивыми». Это создает иллюзию объективности, но разрушает доверие к данным. В итоге A/B-тесты перестают влиять на реальные решения.

Зрелый процесс предполагает, что результат теста может изменить планы. Если это невозможно по организационным причинам, эксперимент изначально не должен запускаться.

В коммуникации самообман проявляется в языке. Команды говорят «данные показали», хотя на самом деле данные были интерпретированы в нужную сторону. Разные участники читают один и тот же отчет по-разному.

Отсутствие заранее согласованных правил интерпретации делает данные инструментом манипуляции. Каждый выбирает те метрики и сегменты, которые поддерживают его позицию.

В зрелой системе A/B-тестирования язык и правила анализа согласованы заранее. Это снижает пространство для самообмана и политических игр.

Артефакты, демонстрирующие зрелость или её имитацию

Зрелость A/B-тестирования всегда проявляется в том, какие артефакты существуют вокруг экспериментов. Если тестирование действительно управляемо, у команды есть фиксированные правила, документы и ритуалы, которые делают процесс прозрачным и повторяемым. Если этих артефактов нет, каждый эксперимент становится уникальным и плохо сопоставимым с предыдущими.

Первый важный артефакт - формализованная гипотеза. Она описывает не само изменение, а предполагаемую причинно-следственную связь. В хорошей гипотезе всегда есть три элемента: контекст, ожидаемое изменение поведения и бизнес-эффект. Без этого данные легко интерпретировать как угодно.

Второй артефакт - заранее зафиксированные метрики и критерии принятия решения. До запуска теста команда должна договориться, какой результат считается успехом, какой нейтральным, а какой негативным. Это снижает риск подгонки выводов под желаемый результат.

Незрелость проявляется тогда, когда артефакты существуют формально или вообще отсутствуют. Гипотезы пишутся задним числом, метрики меняются по ходу эксперимента, а решения принимаются независимо от данных. В таком режиме A/B-тестирование почти гарантированно приводит к самообману.

10 решений PM, ведущих к провалу продукта

Провал 1. Отсутствие бизнес-вопроса.

Эксперимент запускается без понимания, какое решение он должен поддержать.

Провал 2. Гипотеза в виде идеи.

Описывается изменение интерфейса, а не ожидаемое поведение пользователя.

Провал 3. Выбор метрики ради удобства.

Измеряется то, что легко посчитать, а не то, что важно для бизнеса.

Провал 4. Отсутствие критериев успеха.

Команда не знает, что делать при разных исходах теста.

Провал 5. Игнорирование контекста.

Результат рассматривается без учета сезона, трафика и внешних факторов.

Провал 6. Преждевременная остановка.

Тест завершается при первом намеке на значимость.

Провал 7. Подгонка сегментов.

Сегментация используется для поиска «нужного» эффекта.

Провал 8. Фокус на одной метрике.

Побочные эффекты игнорируются.

Провал 9. Отказ от неудобных выводов.

Результат не используется, если он не подтверждает ожидания.

Провал 10. Тестирование ради отчета.

Количество экспериментов важнее качества решений.

Как звучит PM, когда результат не его зона

«Давайте просто попробуем и посмотрим, что получится».

«Если цифры выросли, значит мы правы».

«Этот результат странный, давайте его не учитывать».

«Метрики можно поменять, чтобы было понятнее».

«Главное, что тест статистически значим».

Эти фразы показывают, что данные используются не для поиска истины, а для подтверждения позиции. В такой логике A/B-тестирование неизбежно становится источником самообмана.

Мини-кейс: от проблемы к ценности

Команда маркетплейса активно использовала A/B-тесты для оптимизации конверсии. Каждый спринт запускалось несколько экспериментов, и отчеты регулярно показывали «значимые» улучшения. При этом общая выручка росла медленно.

Анализ показал, что гипотезы формулировались задним числом. Команда сначала придумывала изменение, а затем подбирала метрику, на которой эффект выглядел лучше. Это создавало ощущение прогресса, но не меняло поведение пользователей в целом.

Product Manager предложил изменить подход. Перед запуском каждого теста стали фиксировать бизнес-вопрос и решение, которое будет принято при разных исходах. Метрики и сегменты перестали меняться по ходу эксперимента.

Количество тестов сократилось, но каждый эксперимент стал более осмысленным. Некоторые результаты оказались неудобными и показали отсутствие эффекта там, где его ожидали.

В результате команда отказалась от части идей и сфокусировалась на более крупных изменениях. Рост замедлился на короткой дистанции, но стал устойчивым в долгосрочной перспективе.

Исходная ситуация и её результат

В SaaS-продукте A/B-тесты использовались как основной аргумент в спорах. Разные команды запускали эксперименты, чтобы доказать свою правоту. Одни и те же данные интерпретировались противоположным образом.

Product Manager оказался в сложной позиции. Он отвечал за тестирование, но не мог добиться единых правил интерпретации. Каждый результат становился поводом для конфликта.

Команда решила договориться о базовых принципах. Были зафиксированы основные метрики, правила сегментации и требования к гипотезам. Результаты тестов стали рассматриваться только в рамках этих договоренностей.

Это снизило гибкость интерпретации, но повысило доверие к данным. A/B-тесты перестали быть оружием в спорах и стали инструментом обучения.

Через несколько месяцев качество гипотез заметно выросло. Команда стала лучше понимать, какие изменения действительно влияют на поведение клиентов.

Чек-лист первичной оценки

- Есть ли у теста четкий бизнес-вопрос.

- Зафиксирована ли гипотеза до запуска.

- Понятно ли ожидаемое изменение поведения.

- Выбраны ли ключевые метрики заранее.

- Зафиксированы ли критерии успеха.

- Не меняются ли метрики по ходу теста.

- Учитывается ли контекст эксперимента.

- Анализируются ли побочные эффекты.

- Есть ли договоренность о сегментации.

- Фиксируются ли выводы письменно.

- Используются ли нейтральные результаты.

- Не подгоняются ли интерпретации.

- Может ли результат изменить решение.

- Есть ли единый язык анализа.

- Понимает ли команда ограничения данных.

- Не используется ли тест для оправдания.

- Снижается ли неопределенность.

- Улучшается ли качество гипотез.

- Влияют ли данные на roadmap.

- Помогают ли тесты думать, а не спорить.

FAQ

Можно ли полностью доверять данным A/B-теста?

Нет, данные всегда требуют интерпретации и контекста.

Что опаснее всего в A/B-тестировании?

Подгонка выводов под заранее принятое решение.

Всегда ли статистическая значимость важна?

Она важна, но без понимания эффекта для бизнеса бесполезна.

Что делать с отрицательным результатом?

Использовать его как знание и корректировать гипотезы.

Можно ли запускать тест без гипотезы?

Нет, тогда это не эксперимент, а случайная проверка.

Почему команды обманывают себя данными?

Потому что ожидают от тестов подтверждения идей.

Как снизить риск самообмана?

Фиксировать правила и решения до запуска эксперимента.

Кто отвечает за интерпретацию результатов?

Те, кто принимает решения, а не только аналитики.

Нужны ли A/B-тесты всегда?

Нет, только там, где выбор действительно неочевиден.

Как понять, что логика тестирования работает?

Когда решения становятся проще и обоснованнее.

Логика A/B-тестирования нужна не для того, чтобы находить красивые цифры, а для того, чтобы не обманывать себя данными. Управляемый эксперимент требует дисциплины, честности и готовности принимать неудобные выводы. Когда гипотезы, метрики и решения связаны в единую цепочку, A/B-тесты действительно помогают улучшать продукт. Без этой логики данные превращаются в инструмент самообмана и создают иллюзию объективности там, где ее нет.